-

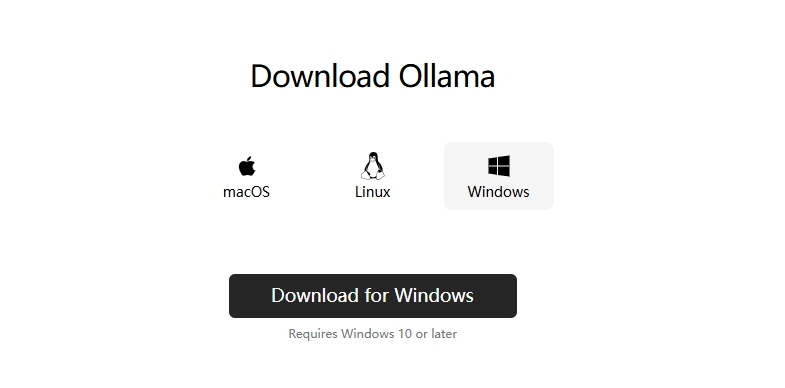

安装Ollama,它可以在本地运行和管理大模型。

Ollama网址:https://ollama.com

选择对应平台下载并安装

-

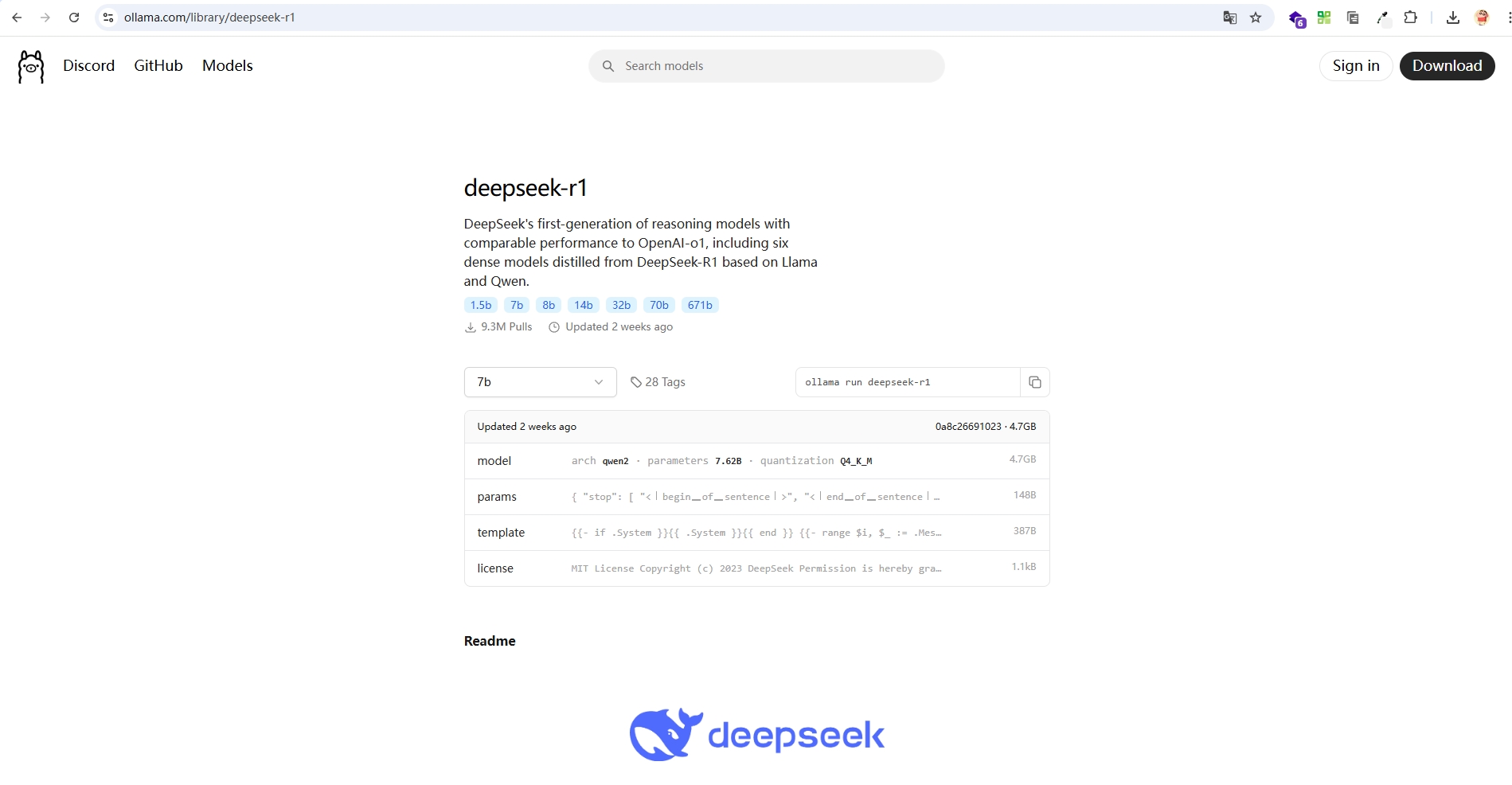

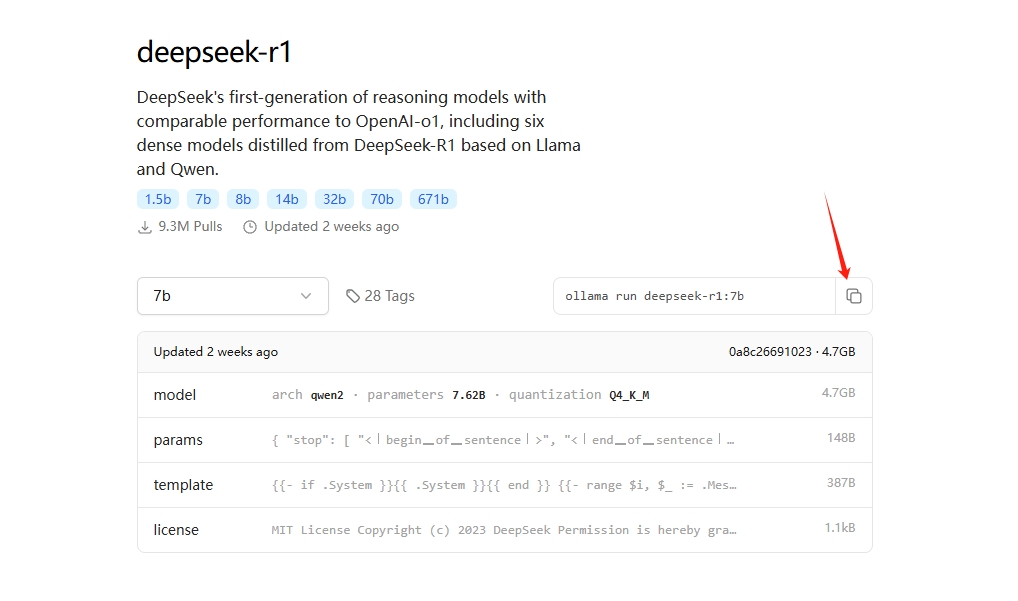

点击Ollama网站左上角的model,找到deepseek r1

-

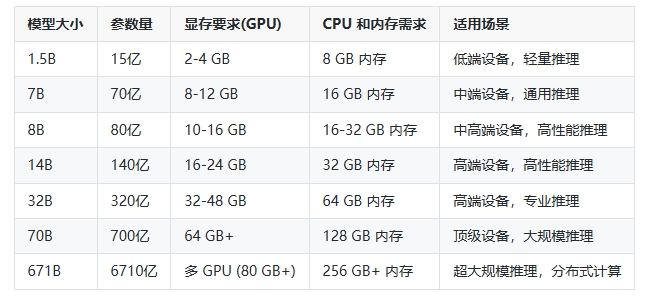

点击下拉菜单,选择对应的版本,不同的版本对配置要求要求不同,可参考下表

-

选择版本后,可在右侧复制相应命令

-

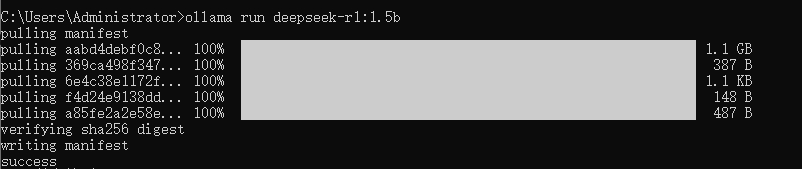

打开命令行,执行命令,而后安装成功,可在命令行内与模型对话

-

安装open-webui开源工具,在web界面对话大模型

- 使用Python安装

# 安装命令 pip install open-webui # 启动命令 open-webui serve - 使用docker安装

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

- 使用Python安装

-

关键命令

# 安装/启动 Ollama ollama run deepseek-r1:1.5b # 启动open-webui open-webui serve