理解“栈”

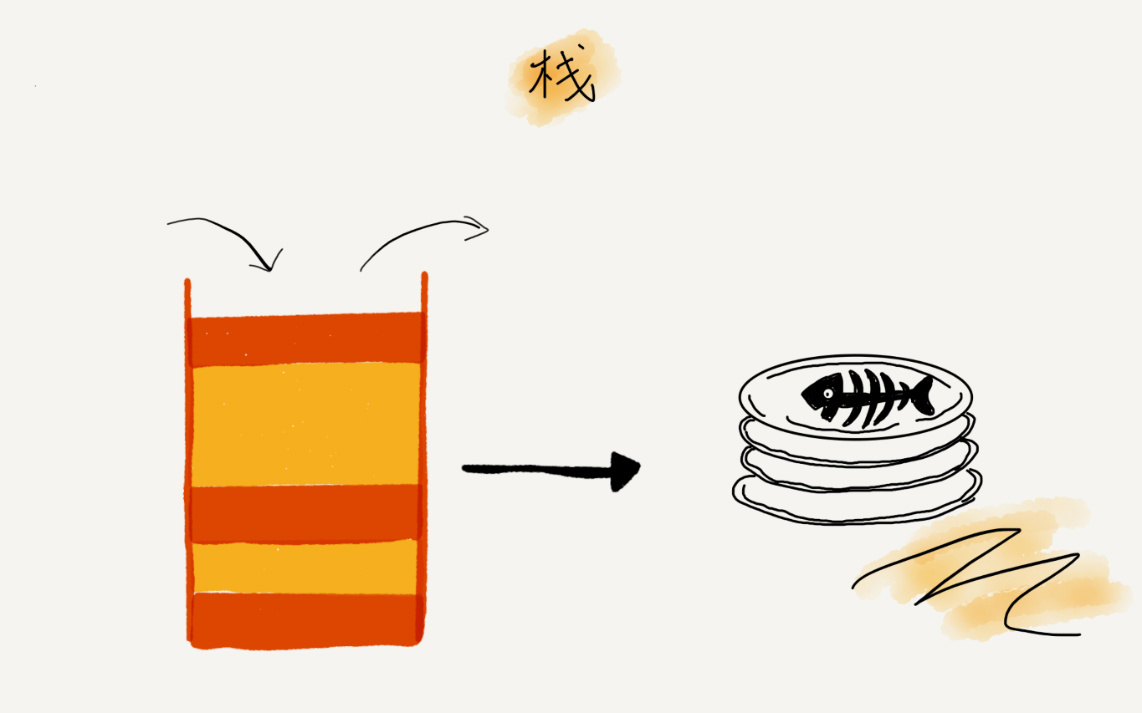

关于“栈”,有一个非常贴切的例子,就是一摞叠在一起的盘子。我们平时放盘子的时候,都是从下往上一个一个的放;取的时候,我们也是从上往下一个一个的依次取,不能从中间任意抽出。后进者先出,先进者后出,这就是典型的“栈”结构。

从栈的操作特性上来看,栈是一种“操作受限”的线性表,只允许在一段插入和删除数据。

从功能上来说,数组或链表确实可以替代栈。但是,特定的数据结构是对特定场景的抽象,而且,数组或链表暴露了太多的操作接口,操作上的确灵活自由,但使用时就比较不可控,自然也就更容易出错。

当某个数据集合只涉及在一端插入和删除数据,并且满足后进先出、后进后出的特性,我们就应该首先“栈”这种数据结构。

如何实现一个“栈”?

从刚才栈的定义里,我们可以看出,栈主要包含两个操作,入栈和出栈,也就是在栈顶插入一个数据和从栈顶删除一个数据。

实际上,栈既可以用数组来实现,也可以用链表来实现。用数组实现的栈,我们叫做顺序栈,用链表实现的栈,我们叫做链式栈。

下面这段代码是基于数组的顺序栈

// 基于数组实现的顺序栈

public class ArrayStack {

private String[] items; // 数组

private int count; // 栈中元素个数

private int n; //栈的大小

// 初始化数组,申请一个大小为n的数组空间

public ArrayStack(int n) {

this.items = new String[n];

this.n = n;

this.count = 0;

}

// 入栈操作

public boolean push(String item) {

// 数组空间不够了,直接返回false,入栈失败。

if (count == n) return false;

// 将item放到下标为count的位置,并且count加一

items[count] = item;

++count;

return true;

}

// 出栈操作

public String pop() {

// 栈为空,则直接返回null

if (count == 0) return null;

// 返回下标为count-1的数组元素,并且栈中元素个数count减一

String tmp = items[count-1];

--count;

return tmp;

}

}了解了定义和基本操作,那它的操作的时间、空间复杂度是多少呢?

不管是顺序栈和链式栈,我们存储数据只需要一个大小为n的数组就够了。在入栈和出栈的过程中,只需要一脸个临时变量存储空间,所以空间复杂度是O(1)。

注意,这里存储数据需要一个大小为n的数组,并不是说空间复杂度就是O(n)。因为,这n个空间是必须的,无法省掉。所以我们说空间复杂度的时候,是指除了原本的数据存储空间外,算法运行还需要额外的存储空间。

空间复杂度分析是不是很简单?时间复杂度也不难。不管是顺序栈还是链式栈,入栈、出栈只涉及栈顶个别数据的操作,所以时间复杂度都是O(1)。

支持动态扩容的顺序栈

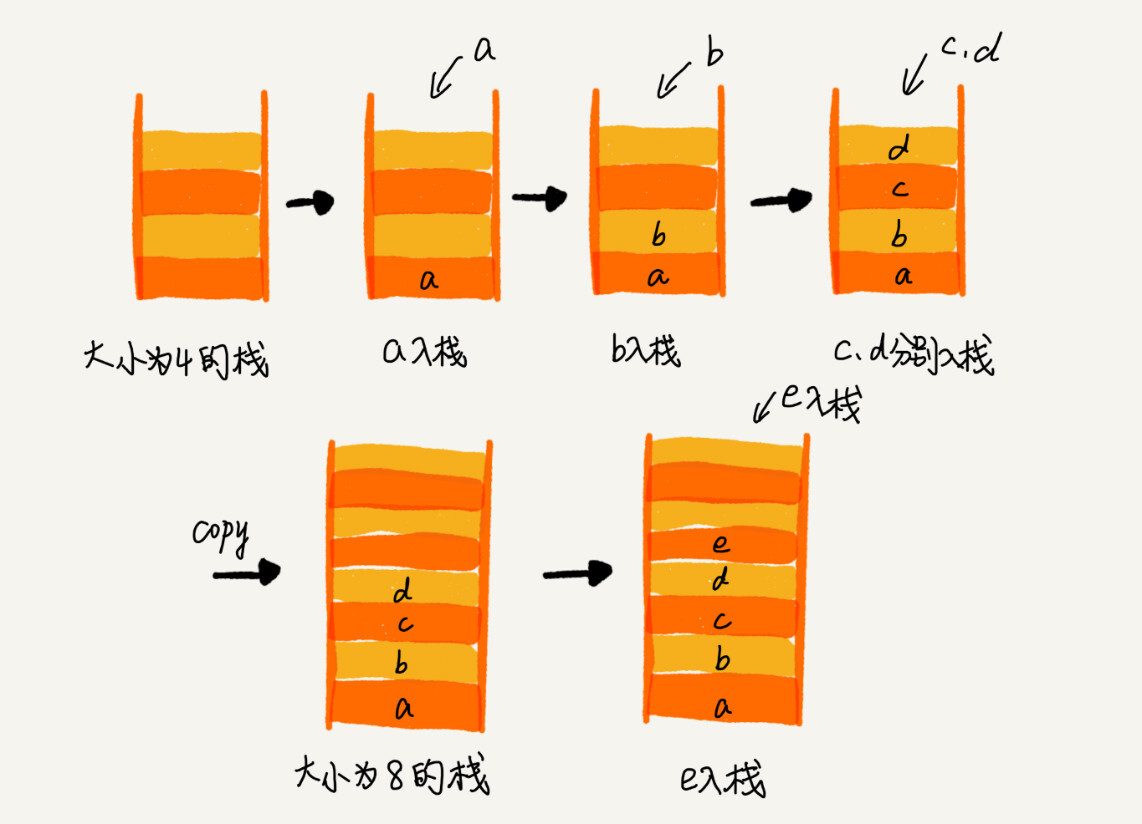

刚才那个基于数组实现的栈,是一个固定大小的栈,也就是说,在初始化栈时需要事先指定栈的大小。当栈满之后,就无法再往栈里面添加数据了。尽管链式栈的大小不受限,但要存储next指针,内存消耗相对较多。

要实现一个支持动态扩容的栈,我们只需要底层依赖一个支持动态扩容的数组就可以了。当栈满了之后,我们就申请一个更大的数组,将原来的数据搬移到新数组中。

实际上,支持动态扩容的顺序栈,我们平时开发中并不经常用到。

对于出栈操作来说,我们不会涉及内存的重新申请和数据的搬移,所以出栈的时间复杂度仍然是O(1)。但是,对于入栈操作来说,情况就不一样了。当栈中有空闲空间时,入栈操作的时间复杂度为O(1)。但当空间不够时,就需要重新申请内存和数据搬移,所以时间复杂度就变成了O(n)。

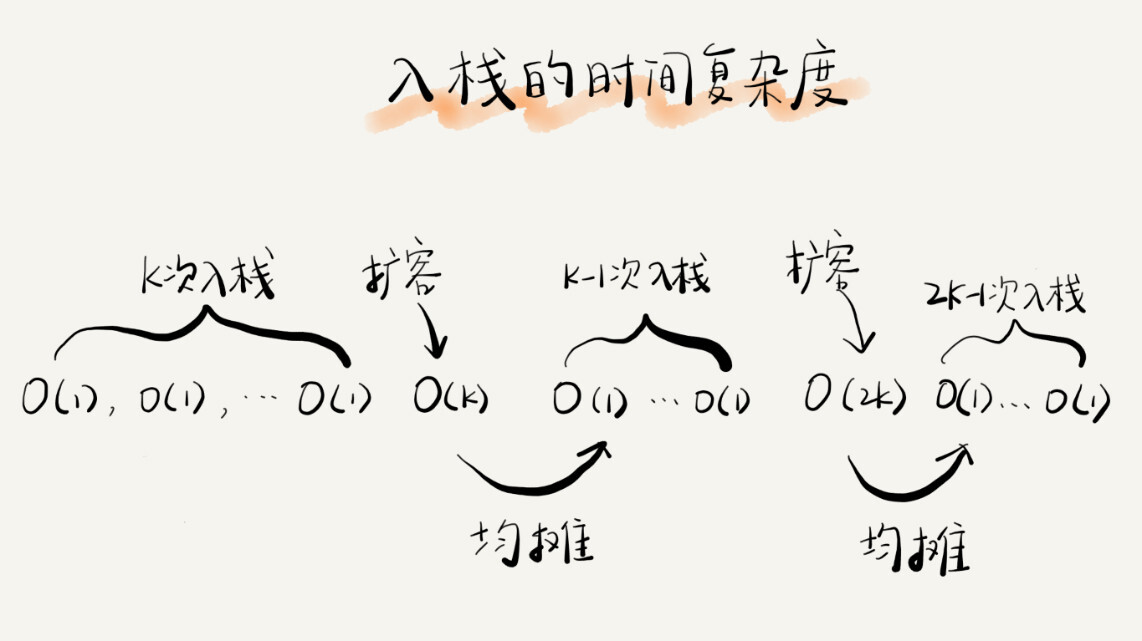

也就是说,对于入栈操作来说,最好情况时间复杂度是O(1),最坏情况时间复杂度是O(n)。那平均情况下的时间复杂度又是多少呢?我们用摊还分析法来实战一下。

为了方便分析,我们需要事先做一些假设和定义:

- 栈空间不够时,我们重新申请一个是原来大小两倍的数组

- 为了简化分析,假设只有入栈操作没有出栈操作

- 定义不设计内存搬移的入栈操作为 simple-push 操作,时间复杂度为O(1)

如果当前栈大小为K,并且已满,当再有新的数据要入栈时,就需要重新申请2倍大小的内存,并且做K个数据的搬移操作,然后再入栈。但是,接下来的K-1次入栈操作,我们都不需要再重新申请内存和搬移数据,所以这K-1次入栈操作都只需要一个simple-push操作就可以完成。

可以看出,这K次入栈操作,总共涉及了K个数据的搬移,以及K次simple-push操作。将K个数据搬移均摊到K次入栈操作,那每个入栈操作只需要一个数据搬移和一个simple-push操作。以此类推,入栈操作的均摊时间复杂度就为O(1)。

通过这个例子的实战分析,也印证了前面讲到的,均摊时间复杂度一般都等于最好情况时间复杂度。因为在大部分情况下,入栈操作的时间复杂度都是O(1),只有在个别情况下才会退化为O(n),所以把耗时多的入栈操作的时间均摊到其他入栈操作上,平均情况下的耗时就接近O(1)。

栈在函数调用中的应用

栈作为一个比较基础的数据结构,应用场景还是蛮多的。其中,比较经典的一个应用场景就是函数调用栈。

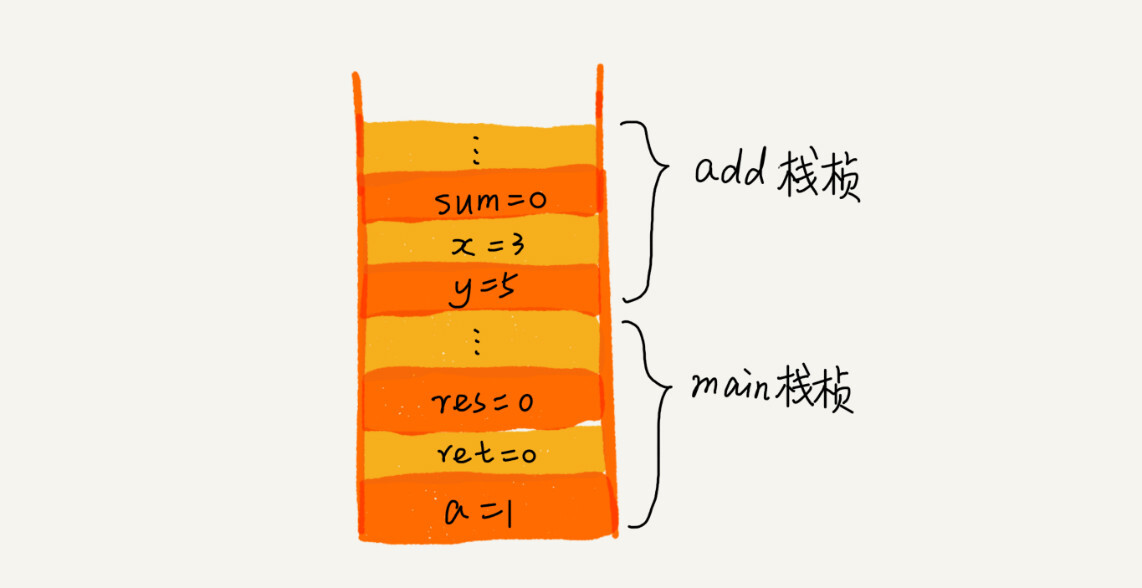

我们知道,操作系统给每个线程分配了一块独立的内存空间,这块内存被组织成“栈”这种结构,用来存储函数调用时的临时变量。每进入一个函数,就会将临时变量作为一个栈帧入栈,当被调用函数执行完成,返回之后,将合格函数对应的栈帧出栈。

int main() {

int a = 1;

int ret = 0;

int res = 0;

ret = add(3, 5);

res = a + ret;

printf("%d", res);

reuturn 0;

}

int add(int x, int y) {

int sum = 0;

sum = x + y;

return sum;

}从代码中可以看出,main()函数调用了add()函数,获取计算结果,并且与临时变量a想加,最后打印res的值。

栈在表达式求值中的应用

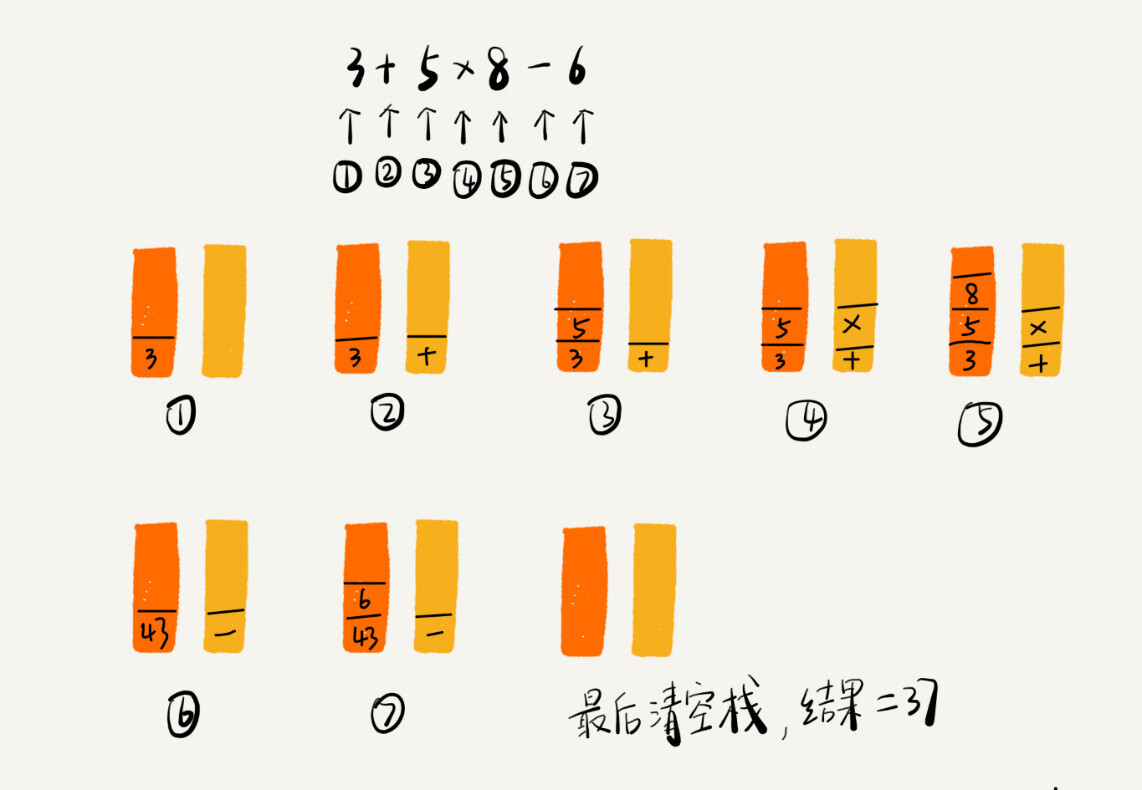

我们再来看栈的另一个常见的应用场景,编译器如何利用栈来实现表达式求值。

为了方便解释,我将算数表达式简化为只包含加减乘除四则运算,比如:34+13*9+44-12/3。对于这个四则运算,我们人喃可以很快求解出答案,但是对于计算机来说,理解这个表达式本身就是个挺难的事儿。

实际上,编译器就是通过两个栈来实现的。其中一个保存操作数的栈,另一个是保存运算符号的栈。我们从左向右遍历表达式,当遇到数字,我们就直接压入操作数栈;当遇到运算符,就与运算符栈的栈顶元素进行比较。

如果运算符栈顶元素的优先级高,就将当前运算符压入栈;如果比运算符栈顶元素的优先级低或者相同,从运算符栈中取栈顶运算符,从操作数栈的栈顶取两个操作数,然后进行计算,再把计算完的结果压入操作栈,继续比较。

下图是 3+5*8-6 的表达式

栈在括号匹配中的应用

除了用栈来实现表达式求值,我们还可以借助栈来检查表达式中的括号是否匹配。

我们同样简化一下背景。我们假设表达式中只包含三种括号,圆括号()、方括号[]和花括号{},并且它们可以任意嵌套。比如,{[]()},而{[}]是不合法格式。

这里也可以用栈来解决。我们用栈来保存未匹配的左括号,从左到右依次扫描字符串。当扫描到左括号时,则将其压入栈中;当扫描到右括号时,从栈顶取出一个左括号。如果能够匹配,比如“(”跟“)”匹配,“[”跟“]”匹配,“{”跟“}”匹配,则继续扫描剩下的字符串。如果扫描的过程中,遇到不能匹配对的右括号,或者栈中没有数据,则说明为非法格式。

当所有的括号都扫描完成之后,如果栈为空,则说明字符串为合法格式;否则,说明还有未匹配的左括号,为非法格式。

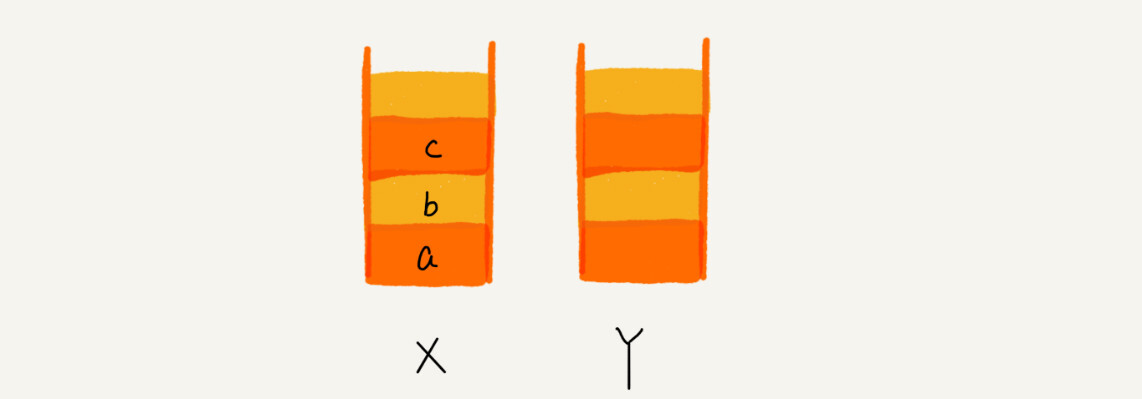

实现浏览器的前进、后退功能

我们使用两个栈,X和Y,我们把首次浏览的页面一次压入栈X,当点击后退按钮时,再一次从栈X中出栈,并将出栈的数据一次放入栈Y。当我们点击前进按钮时,我们依次从栈Y中取出数据,放入栈X中。当栈X中没有数据时,那就说明没有页面可以继续后退浏览了。当栈Y中没有数据,那就说明没有页面可以点击前进按钮浏览了。

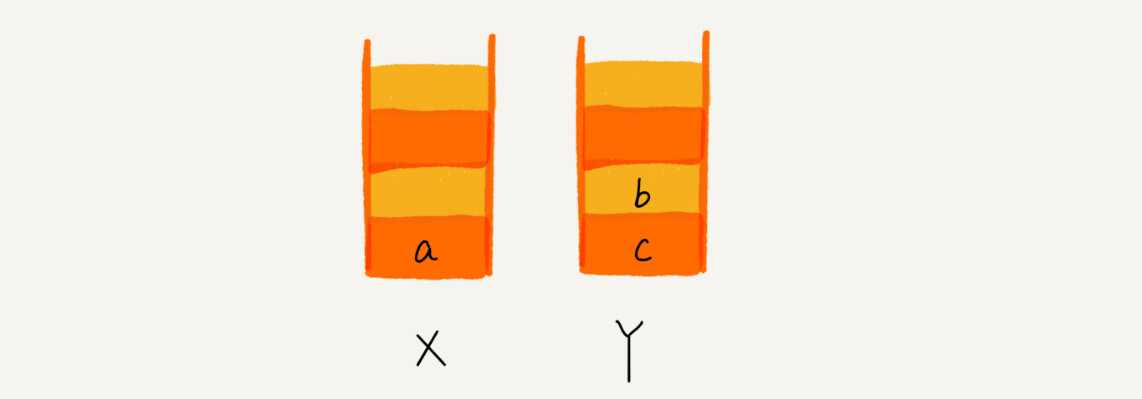

比如顺序查看了a,b,c三个页面,我们就一次把a,b,c压入栈

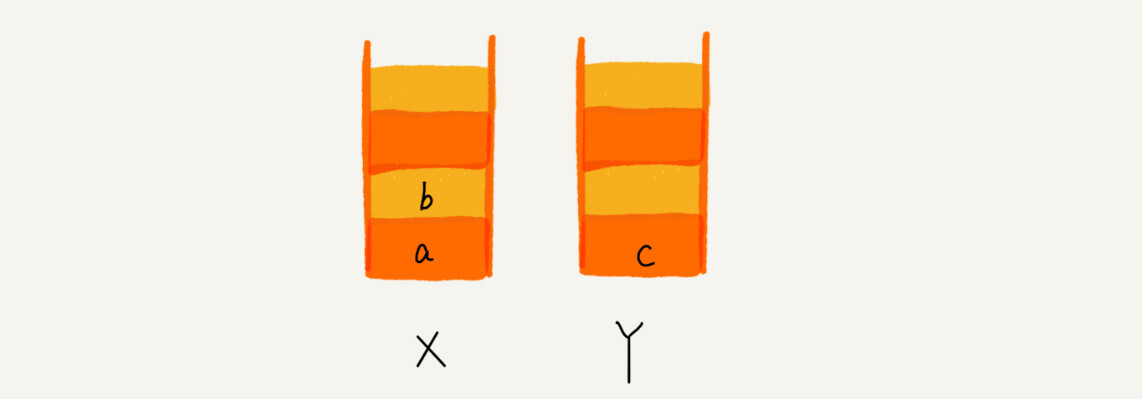

当通过浏览器后退按钮,从页面c后退到页面a之后,我们就依次把c和b从栈X中弹出,并且依次放入到栈Y。

这个时候你又想看页面b,于是又点击前进页面回到b页面,我们就再把b从栈Y中出栈,放入栈X中。

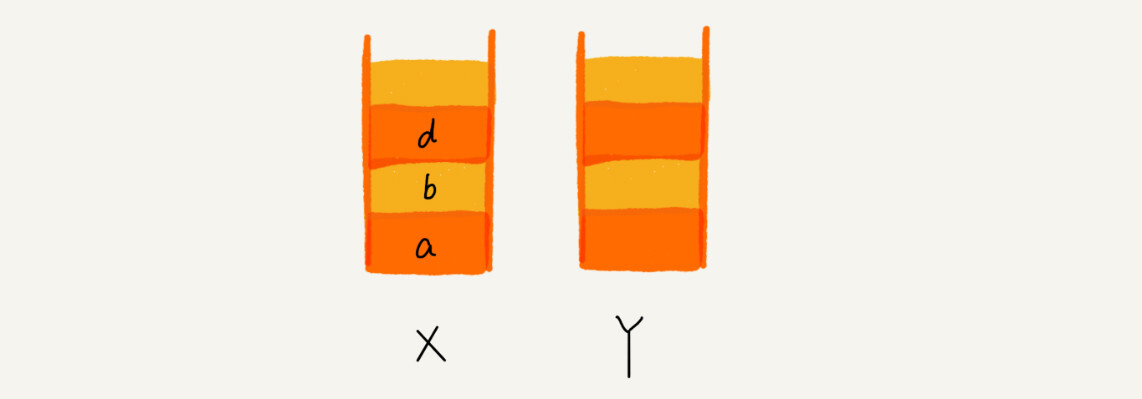

这个时候,你通过页面b又跳转到新的页面d了,页面c就再也无法通过前进、后退按钮重复查看了,所以需要清空栈Y。

小结

栈是一种操作受限的数据结构,只支持入栈和出栈操作。后进先出是它的最大的特点。栈既可以通过数组实现,也可以通过链表来实现。不管基于数组还是链表,入栈、出栈的时间复杂度都为O(1)。